Mirantis tritt als Technology Partner der VAST Cosmos Community auf und entwickelt gemeinsam mit VAST Data einen standardisierten Integrationspfad im k0rdent AI Ökosystem. Neocloud-Betreiber erhalten eine umfassende Orchestrierungsplattform, die komplexe Multi-Vendor-Stacks automatisiert zusammenführt. Der vereinfachte Prozess verkürzt Projektlaufzeiten und minimiert individuelle Konfigurationsaufwände. Gleichzeitig gewährleistet er eine gleichmäßig hohe GPU-Auslastung und optimiert den Datendurchsatz. Das Resultat sind wirtschaftliche KI-Infrastrukturen mit hoher Skalierbarkeit. Betreiber realisieren so stabile, überprüfbare Systeme mit nachvollziehbaren Kosten.

Inhaltsverzeichnis: Das erwartet Sie in diesem Artikel

Multi-Vendor KI-Infrastruktur orchestrieren mit k0rdent AI und VAST Data

Mit der Integration von VAST Data in k0rdent AI bietet Mirantis Neocloud-Betreibern einen klar definierten Pfad zur Einrichtung komplexer KI-Infrastrukturen. Die Kombination aus Kubernetes-nativen Automatisierungstools und dynamischen Datendiensten eliminiert bislang zeit- und kostenintensive Einzelanpassungen. Dadurch verkürzt sich die Time-to-Market für KI-Services deutlich, während Administratoren von einheitlichen Management-Frameworks profitieren. Gleichzeitig gewährleistet die skalierbare Architektur eine nachhaltige Nutzung der GPU-Ressourcen und optimiert den Datendurchsatz über heterogene Speicherlösungen hinweg und steigert Betriebseffizienz messbar.

VAST Data bietet dynamische Datendienste für standardisierte k0rdent AI

Gemeinsam mit VAST Data realisiert Mirantis einen standardisierten Workflow, um das VAST KI-Betriebssystem nahtlos in k0rdent AI zu implementieren. Dies ersetzt aufwendige Einzellösungen durch automatisierte, nachvollziehbare Prozesse und senkt den Aufwand für individuelle Integrationen. Die offene k0rdent-Infrastruktur unterstützt die nahtlose Skalierung und flexible Kombination von Rechen-, Netzwerk- und Speicherkomponenten. Zeitgleich stellt VAST Data intelligente Datendienste bereit, die Latenzen minimieren, den Datendurchsatz erhöhen und GPU-Ressourcen effizient auslasten. Hochperformant für unternehmenskritische Arbeitslasten.

Vereinfachter Betrieb und schnelles Skalieren reduzieren Integrationszeiten heute drastisch

Nach Aussage von Kevin Kamel, Vice President of Product Management bei Mirantis, lastet auf Neocloud-Betreibern ein erheblicher Druck, GPU-Ressourcen ohne Performanceverlust auszuschöpfen. Mit der neuen Kooperation entfallen langwierige Integrationsaufgaben, da vorkonfigurierte Schnittstellen und Automatisierungsmechanismen zum Einsatz kommen. Dies beschleunigt den Infrastrukturoperationsprozess und erhöht die Skalierbarkeit. Entwickler und Admins können sich stärker auf die Qualität der KI-Workloads fokussieren und schneller leistungsstarke Dienste in Produktion bringen. Ressourcenauslastung, Effizienz und Agilität steigen an.

Effiziente Datenpipeline-Optimierung im k0rdent AI Stack maximiert signifikant GPU-Auslastung

Die Latenz und Durchsatzbegrenzung vieler KI-Systeme resultiert aus getrennten Speicher- und Datenmanagementschichten, wodurch GPU-Kapazitäten nicht maximal genutzt werden. VAST Data bietet ein integriertes Datenservice-Ökosystem, das nahtlos Datenaufnahme, Training, Inferenz und agentenbasierte KI-Anwendungen verknüpft. In Verbindung mit k0rdent AI entsteht eine Kubernetes-native Plattform, die dynamische Ressourcenallokation, automatisierte Orchestrierung und optimale Pipeline-Performance bereitstellt, um Hochleistungs-KI-Workloads effizient und skalierbar zu betreiben. Sie unterstützt ferner redundanzfreie Datenströme, verbesserte Fehlertoleranz und kosteneffektive Skalierung sowie Agilität.

Gemeinsame Initiative definiert effiziente Baupläne für skalierbare NVIDIA-geführte GPU-Umgebungen

Durch die Mitarbeit an NVIDIA-geführten Referenzarchitekturen gestalten Mirantis und VAST Data standardisierte Leitplanken für den Aufbau großskaliger GPU-Infrastrukturen. Diese Blaupausen legen fest, wie Compute-Node-Pools, Netzwerk-Topologien und verteilte Speichersysteme optimal orchestriert werden. Betreiber profitieren von vorkonfigurierten, validierten Modulkomponenten, die den Integrationsaufwand minimieren und gleichzeitig die Betriebssicherheit erhöhen. Das Ergebnis ist eine beschleunigte Bereitstellung von KI-Workloads mit vorhersehbarer Performance und konsistenter Ressourcennutzung. Außerdem ermöglichen diese Architekturvorgaben leichtere Updates, schlanke Wartungsprozesse und Optimierung.

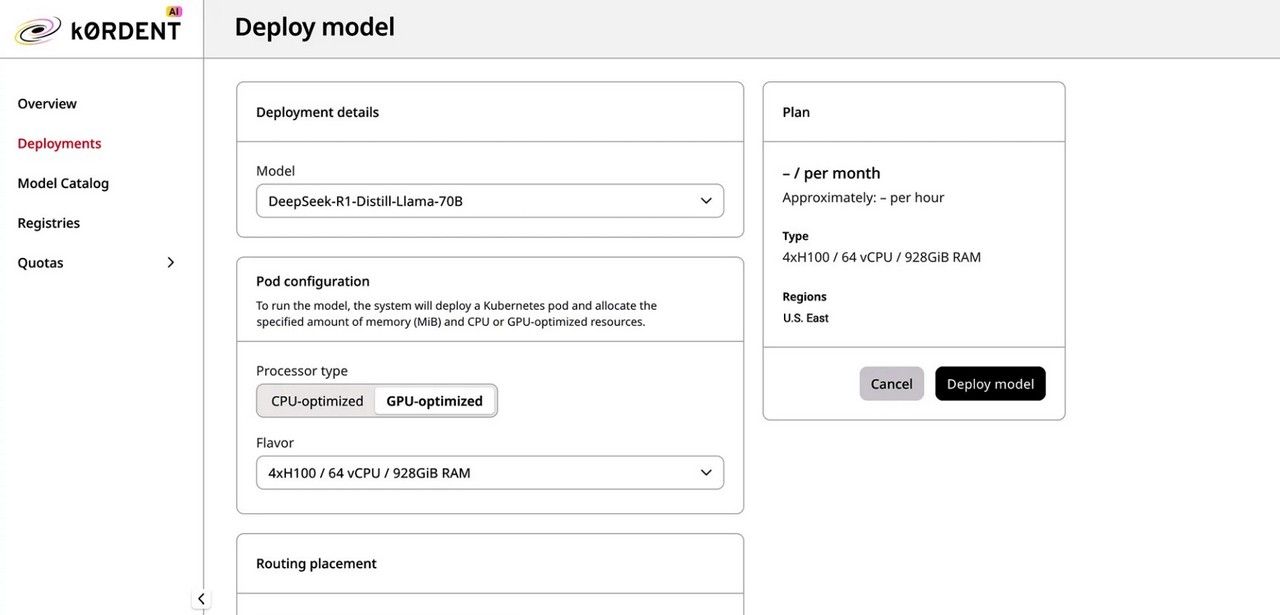

K0rdent native Automatisierung reduziert deutlich Komplexität bei Neocloud-KI-Bereitstellungen effizient

Neocloud-Ingenieure nutzen k0rdent, um KI-Native Workloads auf Kubernetes effizient zu betreiben und komplexe GPU-Cluster zu orchestrieren. Wiederholbare Deployments gewährleisten einheitliche Umgebungsparameter, vermeiden fehleranfällige Einzelanpassungen und beschleunigen Infrastrukturbereitstellungen. Die integrierte Automatisierung reguliert GPU-Verteilung, Lastenausgleich und Ressourcenerweiterung ohne manuellen Aufwand. Dadurch erzielen Betreiber maximale Hardwareeffizienz und reduzieren Onboarding-Zeiten für neue Projekte. Insgesamt entsteht ein skalierbares, wartbares und wirtschaftliches Ökosystem, das sich flexibel an variable KI-Anforderungen adaptieren lässt. Fehlerlösungen werden automatisch versioniert rückverfolgbar.

Die gemeinsame Partnerschaft verkürzt Integrationsaufwand und beschleunigt Hochleistungs-KI-Services-Einsatz massiv

Die Kooperation von Mirantis und VAST Data etabliert einen standardisierten Integrationspfad, der auf offenen Kubernetes-Prinzipien basiert und DevOps-Teams reproduzierbare Deployments ermöglicht. Betreibern stehen modular validierte Komponenten zur Verfügung, die CPU-, Netzwerk- und Storage-Ressourcen dynamisch orchestrieren. Durchgängige Automatisierung erhöht die GPU-Auslastung und reduziert Stillstandzeiten, während referenzierte Architekturen für konsistente Performance und erleichterte Fehlerdiagnose sorgen. Somit lassen sich Hochleistungs-KI-Dienste schneller skalieren und wirtschaftlicher betreiben. Die Lösung integriert umfassende Echtzeit-Überwachung und kontinuierliche Optimierungsmechanismen.